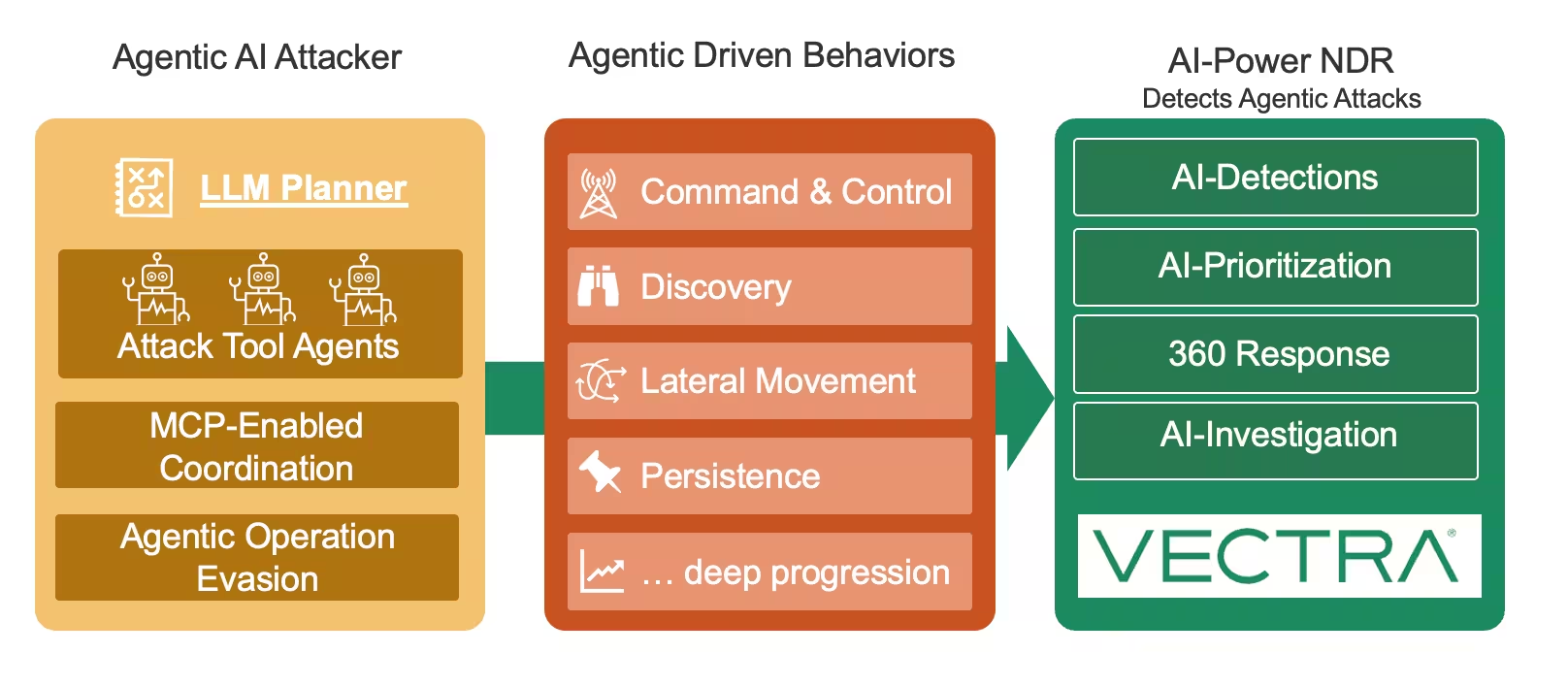

La inteligencia artificial está cambiando la forma en que se diseñan y ejecutan los ataques. Lo que antes requería días de trabajo manual por parte de los operadores, ahora puede ser coordinado por agentes que planifican, ejecutan y se adaptan, y los humanos solo intervienen cuando el sistema necesita orientación.

En Vectra AI, nuestra investigación de código abierto muestra cómo se traduce esto en la práctica: operaciones autónomas impulsadas por MCP que coordinan múltiples «trabajadores» de reconocimiento y acción en un entorno objetivo, al tiempo que reducen al mínimo muchos de los elementos en los que los defensores han confiado históricamente.

Estos ataques alteran la forma, pero no el fondo

Incluso cuando el operador es un agente de IA, el atacante debe alcanzar un objetivo. Para lograrlo, es necesario que se lleven a cabo acciones y comportamientos que sean visibles y, en última instancia, detectables desde la red.

En casi todas las intrusiones reales, la red sigue siendo la vía por la que se producen el descubrimiento, el desplazamiento, la coordinación y el acceso a los datos. Esos comportamientos no son opcionales. Son la esencia misma del ataque.

Lo que demostramos en nuestra investigación

Nuestra investigación, que se presenta aquí y se resume aquí, pone de relieve cómo las arquitecturas basadas en MCP pueden pasar a funcionar con operaciones asíncronas y basadas en eventos, en las que los agentes se conectan cuando es necesario, ejecutan tareas y comunican los resultados, en lugar de depender de los patrones predecibles y repetitivos en los que los defensores se han centrado tradicionalmente.

Es importante destacar que este enfoque permite camuflar la actividad entre lo que parece un uso normal de la IA en la empresa, lo que dificulta la detección cuando herramientas inofensivas generan patrones similares en las API de IA.

También mostramos cómo un enfoque de enjambre mejora la capacidad ofensiva al actuar en paralelo, compartir información rápidamente y continuar con la misión incluso si se detecta a un agente.

Las pruebas del sector apuntan en la misma dirección

No se trata solo de una Vectra AI .

- Basado en MCP equipo rojo agéntico: «Hiding in the AI Traffic» describe una arquitectura habilitada para MCP diseñada para operaciones asíncronas y paralelas y para compartir inteligencia en tiempo real, al tiempo que reduce los artefactos detectables.

- Agentes en entornos reales: un estudio dirigido por la Universidad de Stanford, en el que se comparaban agentes de IA con profesionales humanos de la ciberseguridad en una red universitaria en funcionamiento (con unos 8 000 hosts), revela que ARTEMIS quedó en segundo lugar en la clasificación general, detectó nueve vulnerabilidades válidas y superó a nueve de los diez participantes humanos.

- Escalada en el mundo real: Anthropic informó de que había desarticulado lo que describe como una campaña de ciberespionaje a gran escala orquestada por IA, en la que la IA realizó entre el 80 % y el 90 % del trabajo, con intervención humana solo en unos pocos puntos de decisión.

Lo que los defensas no deben pasar por alto

La IA puede automatizar una parte importante de un ataque y aumentar su sigilo. Sin embargo, no elimina la necesidad de moverse por la red para avanzar.

Por eso, la detección basada en el comportamiento de la red sigue siendo eficaz, incluso cuando las herramientas se vuelven más autónomas y resulta cada vez más difícil distinguir la actividad maliciosa del uso legítimo de la IA.

“«Se ha demostrado que la IA agentiva aumenta la velocidad y reduce el tiempo de intervención de los atacantes, pero no elimina la necesidad de actuar a través de una red. Acciones como el descubrimiento, el movimiento lateral y la comunicación siguen siendo necesarias. Los agentes de IA pueden impulsar el ataque, pero este sigue teniendo que recorrer el mismo camino para alcanzar su objetivo. Nuestra investigación demuestra tanto que esta es la tendencia de los ataques como que los sistemas NDR basados en IA pueden detectar esos comportamientos y neutralizar a los atacantes».

Sohrob Kazerounian, Distinguished AI Researcher deVectra AI

¿Por qué la mejor herramienta para detener los ataques de IA es un NDR basado en IA?

Si los ataques se vuelven más rápidos y se adaptan mejor, las defensas deben hacer lo mismo.

La consecuencia práctica es clara: no es posible defenderse de los ataques automatizados centrándose únicamente en una cadena de herramientas, un tipo de prompt o malware concretos. Se necesita un sistema de detección que se adapte a lo que los atacantes deben hacer, independientemente de si esas acciones las llevan a cabo personas o agentes automatizados.

El NDR basado en IA está diseñado para hacer frente a esa realidad, ya que se centra en los comportamientos necesarios para que una intrusión avance por la red, incluso cuando la coordinación de los atacantes evoluciona hacia patrones más basados en eventos y combinados con IA.

Vectra AI la red híbrida ante la expansión de la IA

A medida que aumenta el uso de la IA, tanto por parte de los atacantes como de las empresas, el resultado Vectra AI es doble.

En primer lugar, Vectra AI y prioriza los comportamientos de red que generan los agentes de IA para llevar adelante un ataque, de modo que los defensores puedan detener las amenazas.

En segundo lugar, Vectra AI visibilidad Vectra AI los equipos de seguridad a medida que las empresas adoptan la IA, de modo que puedan supervisar la actividad de los agentes de IA internos y el uso de la IA —tanto el autorizado como el no autorizado— en toda la empresa.

La IA cambia quién lleva el volante y a qué velocidad se mueve todo. Vectra AI te Vectra AI verlo todo y detener las amenazas que conlleva.

---

Referencias

- Blog Vectra AI , Las nuevas tecnologías traen consigo nuevos riesgos: C2 de enjambre impulsado por MCP (27 de agosto de 2025).

- Janjusevic et al., «Hiding in the AI Traffic: Abusing MCP for LLM-Powered Agentic Red Teaming» (arXiv:2511.15998, noviembre de 2025).

- Anthropic, desmantelamiento de la primera campaña de ciberespionaje orquestada por IA de la que se tiene constancia (noviembre de 2025).

- Lin et al., «Comparación entre agentes de IA y profesionales de la ciberseguridad en pruebas de penetración en entornos reales» (arXiv:2512.09882, 10 de diciembre de 2025).